Bamboo is coming

비지도학습(Unsupervised learning) 본문

비지도학습의 종류

클러스터링 알고리즘(Clustering algorithms)

클러스터링 알고리즘, 즉 군집화 알고리즘은 분류되지 않은 데이터에서 구조나 패턴을 찾는 데 도움을 준다

이상 감지 모델(Anomaly detection)

anomaly detection 알고리즘은 데이터 세트에서 변칙적인 것이나 이례적인 것을 자동으로 감지하고 알려준다. 사기성 거래, 하드웨어 결함 또는 사람의 실수로 인한 잘못된 데이터 포인트를 발견하는 데 유용하다.

잠재 변수 모델(Latent variable models)

데이터가 엄청나게 복잡한 경우에는 데이터를 통한 학습이 어려울 수 있다. 우선, '불량(noisy)' 데이터를 제거하여 단순화함으로써 학습을 용이하게 하고, 데이터에서 의미 있는 인사이트를 찾을 수 있다. 잠재 변수 모델(latent variable model)은 전처리 단계에서 큰 도움이 된다. 차원 축소(dimensionality reduction)로 알려진 기법을 통해 데이터 세트에서 그 특징의 수를 줄이거나 데이터 세트를 여러 구성요소로 분할함으로써 데이터를 단순화시키는 데 기여한다.

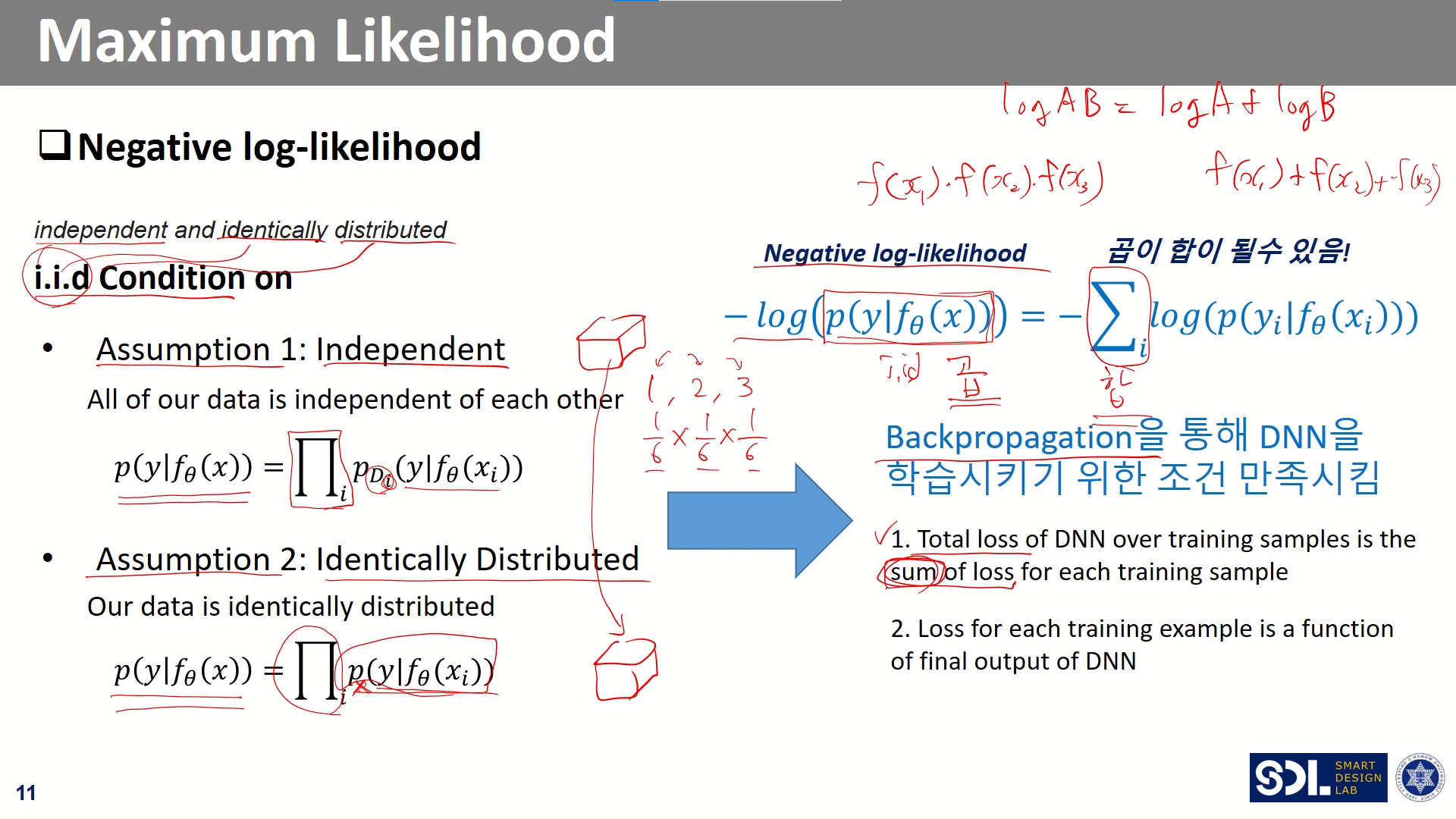

\(f(x_1)\times f(x_2) \times f(x_3)\)보다 \(f(x_1) + f(x_2) + f(x_3)\)가 미분하기 쉬움

왜? 각각을 미분해서 더하면 되니까

log의 성질 중 logAB = logA+logB로 바꿀 수 있으므로 곱을 합으로 바꾸어 미분하기 쉽게 만듬

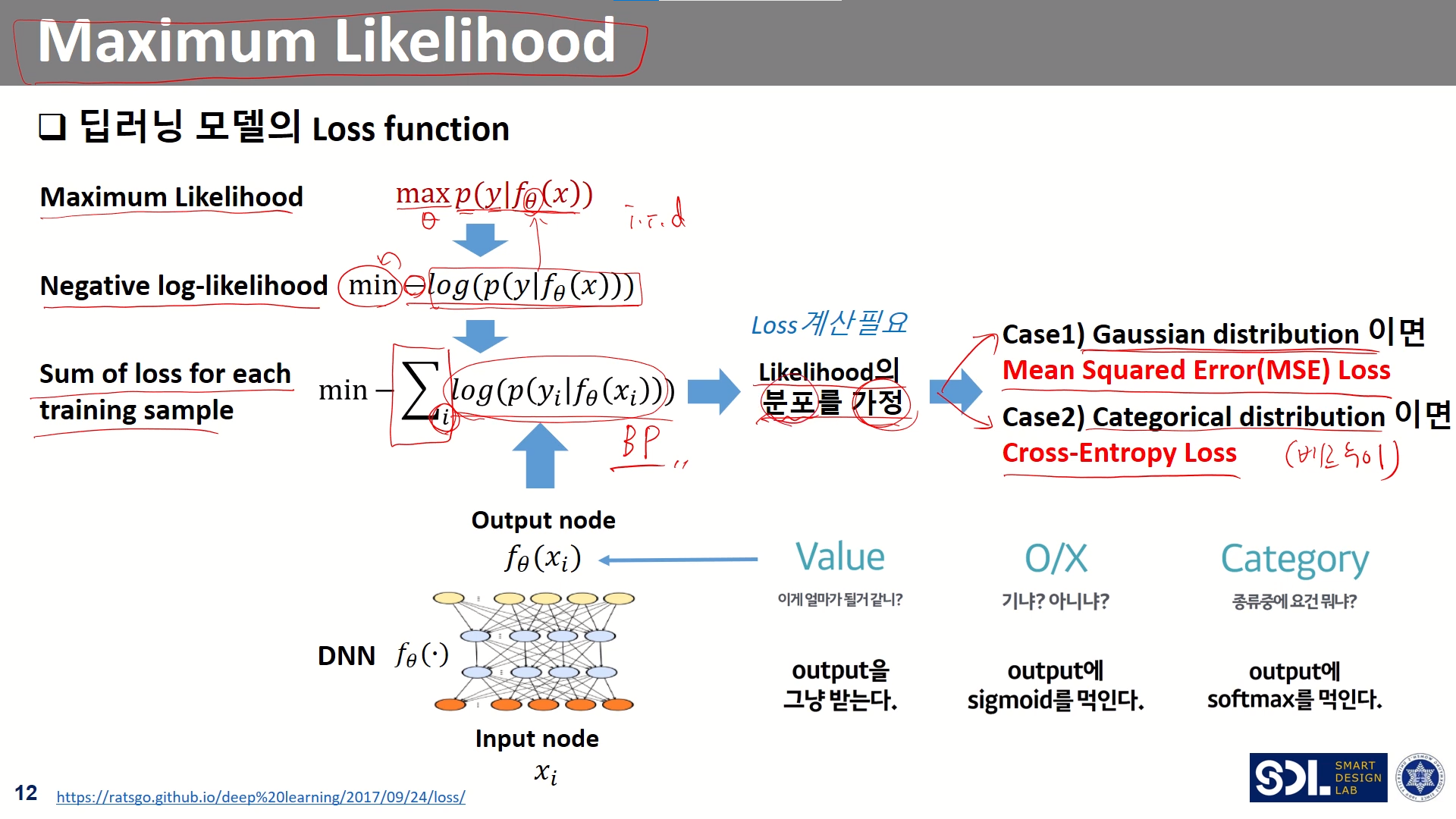

앞서 본 것과 같이 maximum likelihood인 \(p(y|f_\theta(x))\)는 negative-log-likelihood인 \(log(p(y|f_\theta(x)))\)로 계산해주기로 했고 max를 min -를 붙여서 바꿔줬다.

그리고 loss 계산은 분포에 따라 정해진다.

negative log-likihood에서 유도해본다면 \(f_\thetha(x_i)\)를 \(\mu\)로 두고 \(\sigma\)는 1로 두고 계산을 한다.

마지막에 상수인 log부분은 사라지고 mse만 남는다.

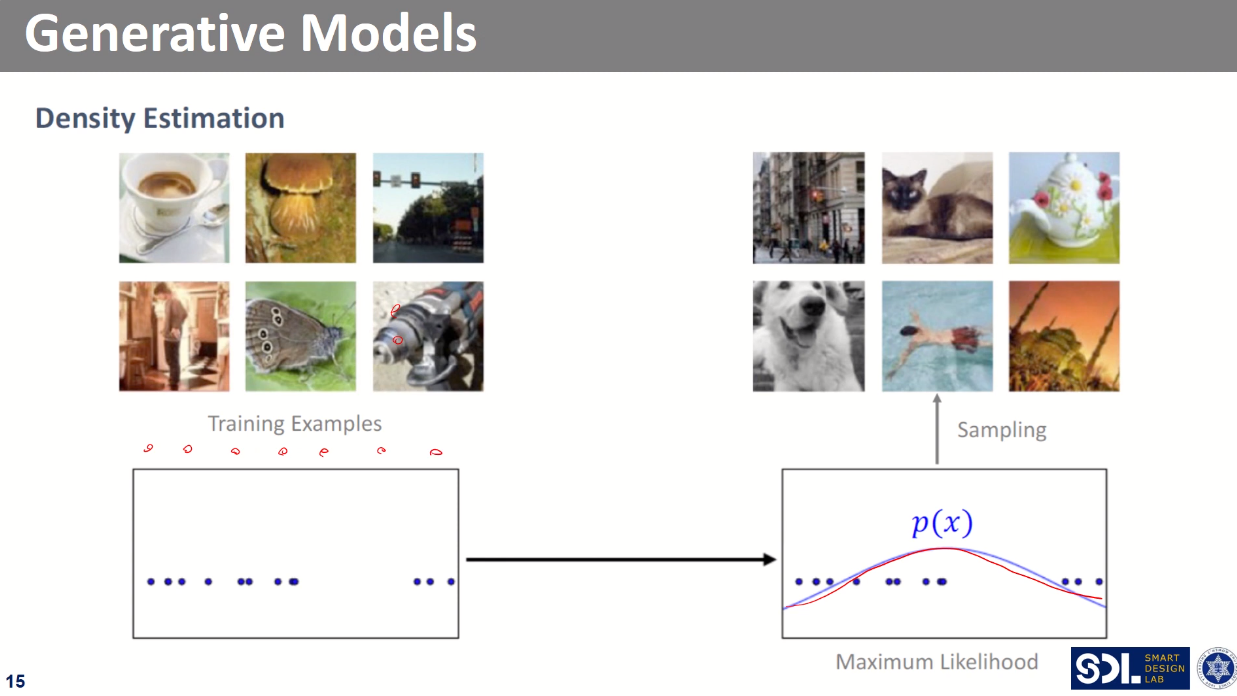

이미지는 의미 있는 확률 분포를 가지고 있다. 그래서 의미 있는 출력값을 만들 수 있는 것이다 .

분포에 따라서 비슷한 이미지 분류를 가질 수 있다.

Generative models은 결국 원래 학습 데이터와 가장 유사한 분포를 가지도록 학습하는 방법이다. 이를 샘플링하면 사람의 형상이 나올 수 있다.

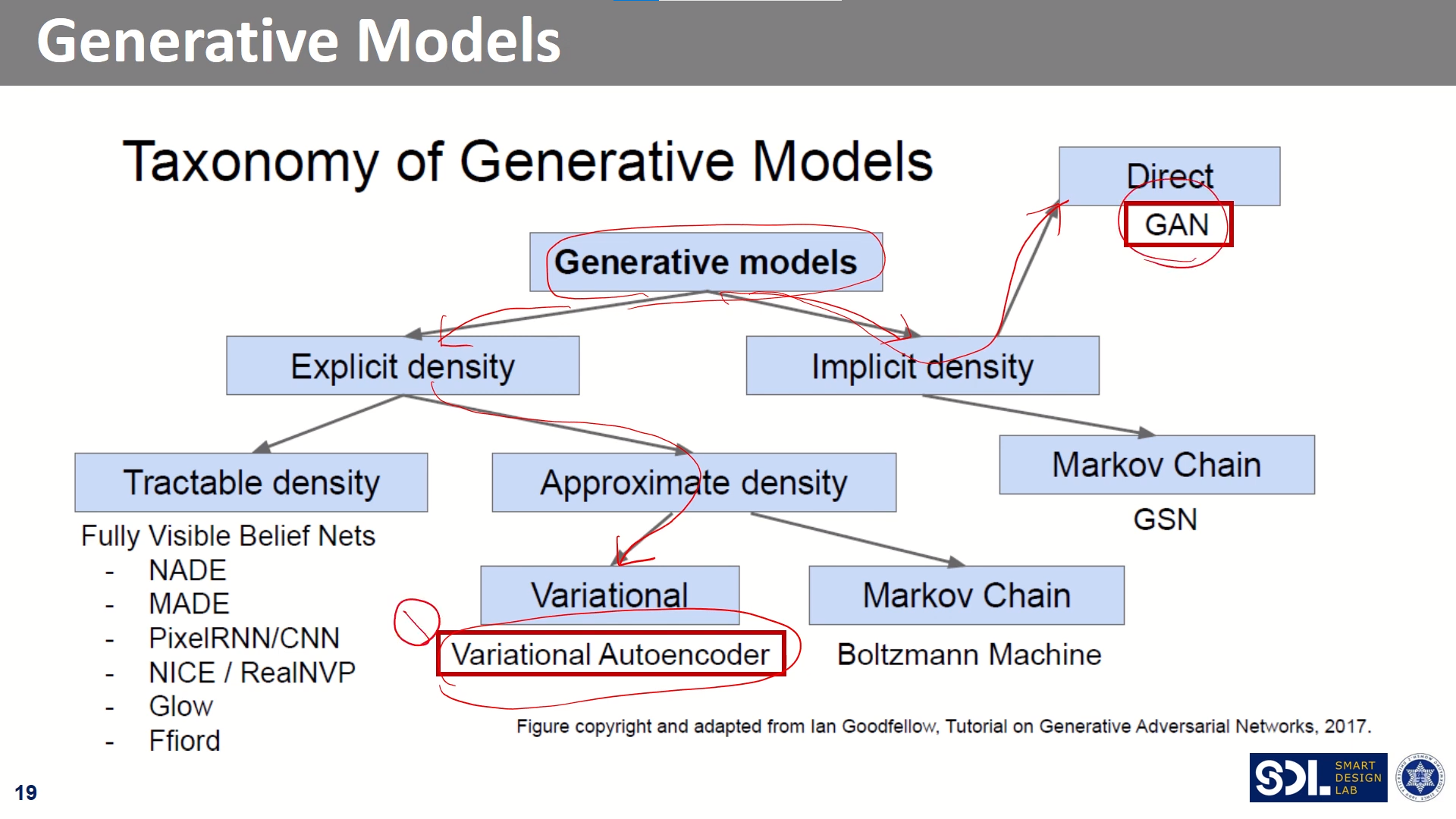

p모델을 찾기 위해서 확률분포를 정의하는(예, 가우시안 분포를 따른다고 가정) explicit density 모델과 그냥 학습하는 implicit density 모델으로 나눌 수 있다.

왜 생성형 모델이 필요한가?

우방 사진, 얼굴, 타임시리즈 데이터도 생성해 낼 수 있다.

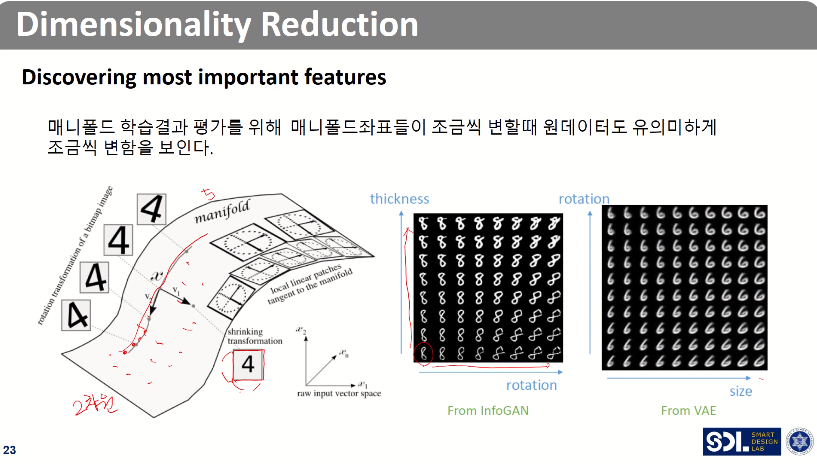

생성형 모델의 가장 큰 목표는 차원 축소(manifod learning)이다.

manifold learning을 배우기 전에 알아야 하는 차원의 저주이다.

차원이 증가할 수록 데이터의 분포분석 또는 모델 추정에 필요한 샘플 데이터의 개수가 기하 급수적으로 증가한다.

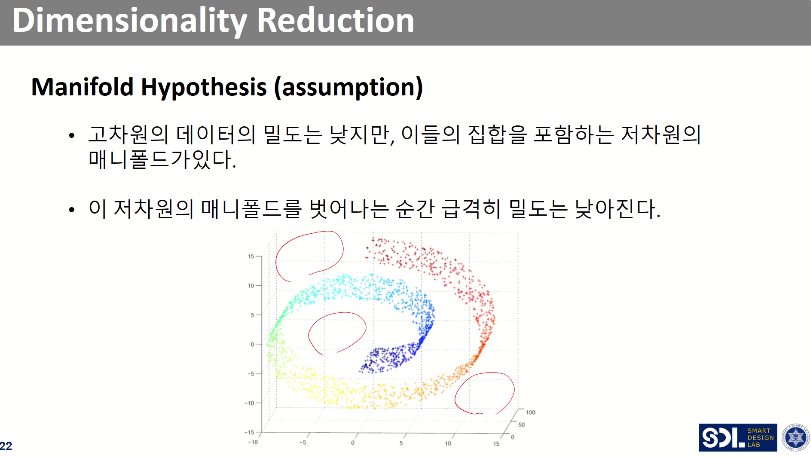

Manifold Hypothesis

3차원 데이터를 보았을 때 특정 영역에 밀도가 모여있고 이를 2차원으로 펼 수 있다는 개념을 생각해냄.

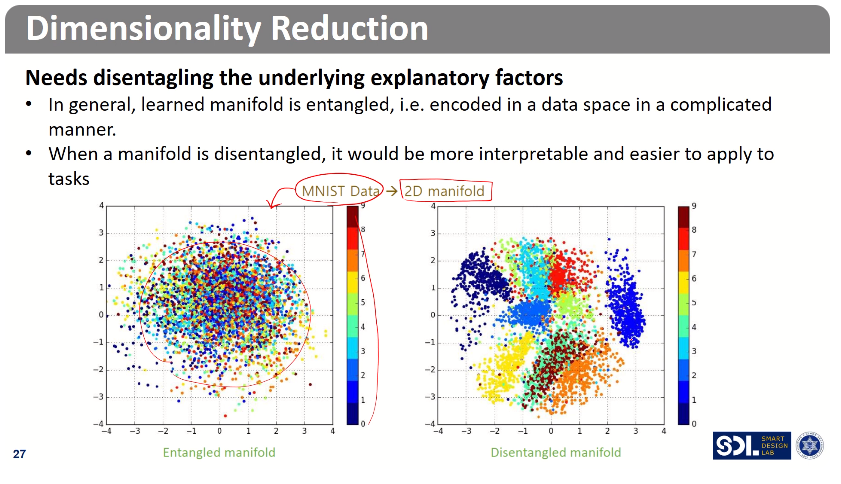

mnist의 고차원 데이터도 2차원 manifold를 찾았다.

고차원의 데이터를 분석할 필요 없이 2차원의 manifold로 변형이 가능하다.

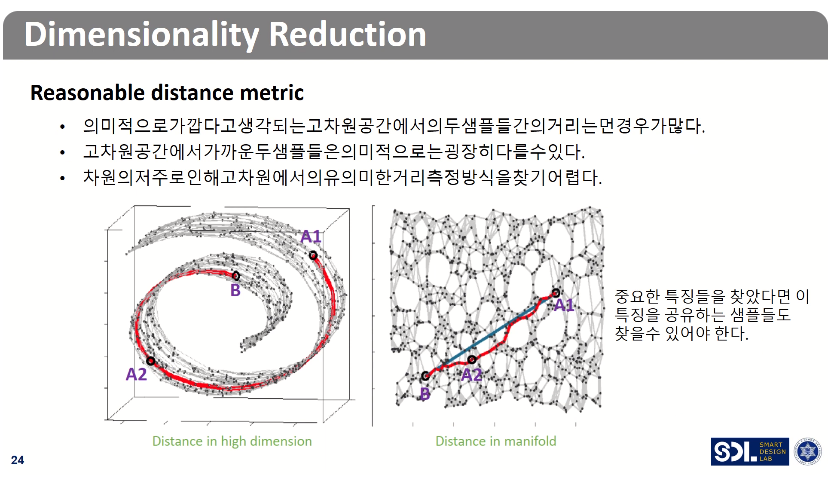

거리가 가까우면 데이터가 유사할 경우가 많다. 매니폴드 상에서 A1과 A2가 가깝고 B가 가장 멀다. 저차원의 매니폴드를 잘 찾으면 주요 특징이 잘 반영된 사진을 볼 수 있음

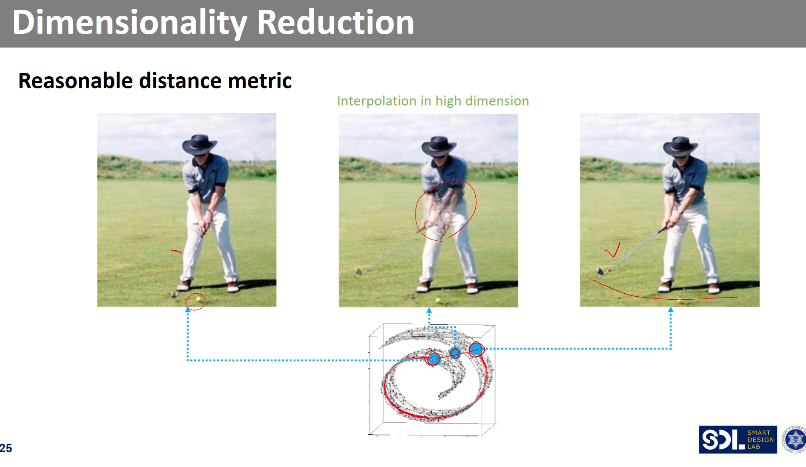

차원에서의 중간을 interpolation하면 이상한 데이터가 나오지만 메니폴드 상의 중간 데이터를 interplation하면 정상적인 데이터가 나옴

dimensionality reduction이 중요하다. 이건 결국 매니폴드를 찾는 과정이다.

비지도학습 강의 (hhttps://youtube.com/playlist?list=PLQASD18hjBgyLqK3PgXZSp5FHmME7elWS&si=BrNEskTYdVokYz_1)

비지도학습 (https://www.appier.com/ko-kr/blog/a-simple-guide-to-unsupervised-learning)

'인공지능 개념' 카테고리의 다른 글

| VAE(Variation Auto Encoder) (0) | 2023.10.26 |

|---|---|

| 생성형 AI 평가지표 (0) | 2023.10.17 |

| 생성형 모델 (1) | 2023.10.04 |

| 트랜스포머 (0) | 2023.09.08 |

| Domain Adaption (0) | 2023.09.07 |